Statistiques, un outils magique !

Publié : 27 févr. 2013, 00:25

Salut,

Je vais vous faire part d'une petite subtilité de statistique à laquelle j'ai été confronté il y a maintenant 2 ans.

Ceux qui n'ont pas envie de ce creuser les méninges, passez votre chemin ...

Je pense que tous ici vous savez calculer une moyenne ? Bon pour les plus distrait rappelons l'expression de la moyenne pour un ensemble de N valeurs \(X_i\)

\(\bar{X} = \frac{1}{N}\sum X_i\)

Ok, ok certain doivent se dire : "mais il nous prend pour des noeunoeuds le bougre." ... mais non les choses marrantes (enfin marrantes ça dépend du point de vue, hein) arrivent.

Bon maintenant peut-être qu'un peu moins sont familier avec le concept de moyenne pondérée ... par exemple pour optimiser les incertitudes.

En effet souvent on fait mumuse avec des valeurs \(X_i\) qui ont une certaine incertitude. Une façon intelligente de calculer la moyenne devient alors :

\(\bar{X} = \frac{\sum X_i \sigma_i^{-2}}{\sum \sigma_i^{-2}}\)

Où \(\sigma_i\) est l'incertitude respective de chaque valeur \(X_i\)

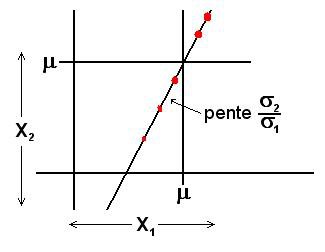

Ok, ok, on attaque la partie dur ... maintenant certaines valeurs de \(X_i\) peuvent avoir des incertitudes corrélées ... on considère donc la matrice de covariance \(C\) des incertitudes dont les terme diagonaux sont \(\sigma_i^2\) et les termes non diagonaux \(\rho_{i,j}\sigma_i \sigma_j\), avec \(\rho_{i,j} = \rho_{j,i}\) un coeff de corrélation compris obligatoirement entre -1 et 1 indiquant le niveau de corrélation entre les incertitudes sur \(X_i\) et \(X_j\).

Maintenant la moyenne s'écrit:

\(\bar{X} = (1^T .C^{-1} .1)^{-1}. 1^T .C^{-1} . X\)

Avec \(1\) un vecteur de N éléments ne contenant que des 1, \(X\) un vecteur contenant les valeurs \(X_i\) et l'opérateur \(.\) désigne le produit matriciel.

Bon pour ceux qui ne dorment pas encore voici la partie intéressante qui va vous faire mal aux neurones:

Prenez :

\(N = 2\)

\(X_1 = 4.9\)

\(X_2 = 5.0\)

\(\sigma_1 = 1\)

\(\sigma_2 = \sqrt{2}\)

\(\rho_{1,2} = 0.9\)

Calculez la moyenne avec l'expression matricielle (qui donne la valeur la plus proche de la valeur exacte, ce qui est vérifiable en faisant des simulations).

Vous trouvez 4.84 ...

La moyenne de 4.9 et 5.0 est dans ce cas 4.84 ... oui oui, vous lisez bien, la moyenne n'est pas encadrée par les deux valeurs ayant servies à la calculer.

C'est beau les statistiques ...

Comme quoi on peut parfois être confronté à des choses vraiment strange ...

Ce résultat vous surprend ? Ne soyez pas traumatisé, ce résultat surprend aussi des chercheurs aguerri ... C'est toujours marrant de faire saigner le cerveau des collègues .

.

Ceux qui sont encore qu lycée ... parlez en a vos profs de Maths ... y a de grandes chances qu'ils ne vous croient pas .

.

Alors ça vous as plu ???

Si certain aime, je posterais peut-être d'autre "weirditée" du monde "statistique" sur ce fil ...

@+,

G> qui espère faire saigner des cerveaux .

.

Je vais vous faire part d'une petite subtilité de statistique à laquelle j'ai été confronté il y a maintenant 2 ans.

Ceux qui n'ont pas envie de ce creuser les méninges, passez votre chemin ...

Je pense que tous ici vous savez calculer une moyenne ? Bon pour les plus distrait rappelons l'expression de la moyenne pour un ensemble de N valeurs \(X_i\)

\(\bar{X} = \frac{1}{N}\sum X_i\)

Ok, ok certain doivent se dire : "mais il nous prend pour des noeunoeuds le bougre." ... mais non les choses marrantes (enfin marrantes ça dépend du point de vue, hein) arrivent.

Bon maintenant peut-être qu'un peu moins sont familier avec le concept de moyenne pondérée ... par exemple pour optimiser les incertitudes.

En effet souvent on fait mumuse avec des valeurs \(X_i\) qui ont une certaine incertitude. Une façon intelligente de calculer la moyenne devient alors :

\(\bar{X} = \frac{\sum X_i \sigma_i^{-2}}{\sum \sigma_i^{-2}}\)

Où \(\sigma_i\) est l'incertitude respective de chaque valeur \(X_i\)

Ok, ok, on attaque la partie dur ... maintenant certaines valeurs de \(X_i\) peuvent avoir des incertitudes corrélées ... on considère donc la matrice de covariance \(C\) des incertitudes dont les terme diagonaux sont \(\sigma_i^2\) et les termes non diagonaux \(\rho_{i,j}\sigma_i \sigma_j\), avec \(\rho_{i,j} = \rho_{j,i}\) un coeff de corrélation compris obligatoirement entre -1 et 1 indiquant le niveau de corrélation entre les incertitudes sur \(X_i\) et \(X_j\).

Maintenant la moyenne s'écrit:

\(\bar{X} = (1^T .C^{-1} .1)^{-1}. 1^T .C^{-1} . X\)

Avec \(1\) un vecteur de N éléments ne contenant que des 1, \(X\) un vecteur contenant les valeurs \(X_i\) et l'opérateur \(.\) désigne le produit matriciel.

Bon pour ceux qui ne dorment pas encore voici la partie intéressante qui va vous faire mal aux neurones:

Prenez :

\(N = 2\)

\(X_1 = 4.9\)

\(X_2 = 5.0\)

\(\sigma_1 = 1\)

\(\sigma_2 = \sqrt{2}\)

\(\rho_{1,2} = 0.9\)

Calculez la moyenne avec l'expression matricielle (qui donne la valeur la plus proche de la valeur exacte, ce qui est vérifiable en faisant des simulations).

Vous trouvez 4.84 ...

La moyenne de 4.9 et 5.0 est dans ce cas 4.84 ... oui oui, vous lisez bien, la moyenne n'est pas encadrée par les deux valeurs ayant servies à la calculer.

C'est beau les statistiques ...

Comme quoi on peut parfois être confronté à des choses vraiment strange ...

Ce résultat vous surprend ? Ne soyez pas traumatisé, ce résultat surprend aussi des chercheurs aguerri ... C'est toujours marrant de faire saigner le cerveau des collègues

Ceux qui sont encore qu lycée ... parlez en a vos profs de Maths ... y a de grandes chances qu'ils ne vous croient pas

Alors ça vous as plu ???

Si certain aime, je posterais peut-être d'autre "weirditée" du monde "statistique" sur ce fil ...

@+,

G> qui espère faire saigner des cerveaux